DeepSeek V4 评测:开源模型能否替代 GPT-5?成本对比与接入实测

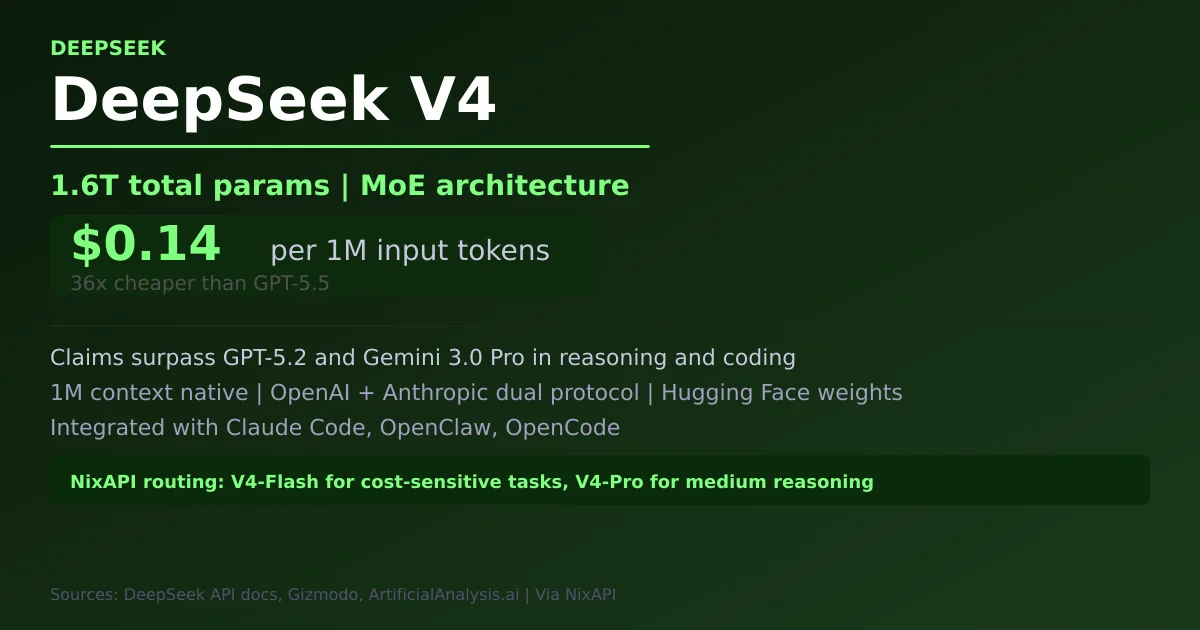

DeepSeek 于 2026 年 4 月 24 日发布 V4 预览版,V4-Pro-Max 达 1.6 万亿参数(490 亿激活),V4-Flash 仅 $0.14/百万输入 token。声称在推理和编程上超越 GPT-5.2 和 Gemini 3.0 Pro,完全开源且权重可下载。本文实测 V4 Flash 的 API 接入、Benchmarks 表现,并与 GPT-5.5、Claude Opus 4.7 做全面成本对比。

注: 数据来源为 DeepSeek 官方 API 文档(api-docs.deepseek.com)、Gizmodo、AI/ML 分析平台(ArtificialAnalysis.ai)、Reddit r/LocalLLaMA。所有接入建议均基于公开 API 文档。

一、发布概览:开源最强 MoE 模型来了

DeepSeek 于 2026 年 4 月 24 日发布 V4 预览版,两款模型同步上线:

| 模型 | 总参数量 | 激活参数 | 架构 |

|---|---|---|---|

| DeepSeek-V4-Pro | 1.6 万亿 | 490 亿 | MoE(混合专家) |

| DeepSeek-V4-Flash | 2840 亿 | 130 亿 | MoE |

DeepSeek 官方公告确认:「DeepSeek-V4 已与 Claude Code、OpenClaw 和 OpenCode 等领先 AI Agent 深度集成。」V4-Flash 的 API 已上线,V4-Pro 权重已在 Hugging Face 完全开放下载。

二、API 定价:$0.14/M 输入,18 倍价格优势

DeepSeek V4 Flash 官方定价(Gizmodo 确认):

| 模型 | 输入 Token | 输出 Token | 比较 |

|---|---|---|---|

| DeepSeek-V4-Flash | $0.14 / 百万 | $0.28 / 百万 | 基准 |

| DeepSeek-V4-Pro | 约 $0.50-1/M | 约 $1-2/M | — |

| GPT-5.5 | $5 / 百万 | $30 / 百万 | 36× 更贵 |

| GPT-5.5 Pro | $30 / 百万 | $180 / 百万 | 214× 更贵 |

| Claude Opus 4.7 | $5 / 百万 | $25 / 百万 | 36× 更贵 |

| Gemini 3.1 Pro | ~$1-2/M | ~$5-10/M | 7-14× 更贵 |

V4-Flash 的输入价格比 GPT-5.5 便宜 约 36 倍,这使其成为成本敏感型工作负载的理想选择。

三、基准测试:开源能否比肩顶级闭源?

根据 DeepSeek 官方披露的基准测试数据:

| 基准测试 | DeepSeek-V4-Pro | GPT-5.2 | Gemini 3.0 Pro | 说明 |

|---|---|---|---|---|

| 推理(Math/STEM/Coding) | SOTA 开源 | 接近 | 接近 | 声称超越所有开源模型 |

| Agentic Coding | 开源 SOTA | — | — | 领先所有当前开源模型 |

| 世界知识 | 仅次于 Gemini 3.1 Pro | — | — | 开源最强 |

| 上下文效率 | 世界领先 | — | — | Token 压缩 + DSA |

DeepSeek 技术报告重点强调:

「Novel Attention:Token-wise compression + DSA(DeepSeek Sparse Attention),实现世界领先的长上下文效率,同时大幅降低计算和内存成本。」

1M context 现已作为所有 DeepSeek 官方服务的默认标准。

四、V4 Flash 接入实测(APIYI 定价参考)

第三方 AI API 聚合平台 ArtificialAnalysis.ai 显示 V4 Flash 各提供商对比:

| 提供商 | 输入 Token 价格 | 输出 Token 价格 | 首 Token 延迟 |

|---|---|---|---|

| DeepSeek 官方 | $0.14/M | $0.28/M | 0.95s |

| APIYI 等中间商 | 约 $0.14/M | 约 $0.28/M | 略高 |

DeepSeek 官方 API 端点:api.deepseek.com(支持 OpenAI ChatCompletions 和 Anthropic API 双协议)。

五、V4 Flash 与 V4 Pro 选型决策

| 场景 | 推荐模型 | 原因 |

|---|---|---|

| 简单 Agent 任务 | V4-Flash | 性能与 Pro 相当,更快更便宜 |

| 复杂推理 / 编程 | V4-Pro | 490 亿激活参数,推理能力更强 |

| 超长上下文(>100K tokens) | V4-Pro / Flash | 1M context 原生支持 |

| 高精度关键任务 | GPT-5.5 或 Opus 4.7 | 闭源顶级模型保障更高可靠性 |

| 中国市场 / 中文场景 | V4-Pro / Flash | 中文理解能力强,开源可本地部署 |

| 预算极度敏感 | V4-Flash | $0.14/M 输入,业界最低之一 |

六、NixAPI 接入路径

// providers/deepseek-v4.ts

import OpenAI from 'openai';

const deepseek = new OpenAI({

apiKey: process.env.DEEPSEEK_API_KEY,

baseURL: 'https://api.deepseek.com/v1',

});

// NixAPI 路由策略:DeepSeek 作为成本优先层

export async function routeTask(task: Task) {

// 成本极度敏感 + 简单任务 → V4 Flash

if (task.costSensitive && task.difficulty === 'simple') {

return deepseek.chat.completions.create({

model: 'deepseek-v4-flash',

messages: task.messages,

max_tokens: 512,

});

}

// 中等复杂推理 → V4 Pro

if (task.difficulty === 'medium' && !task.costInsensitive) {

return deepseek.chat.completions.create({

model: 'deepseek-v4-pro',

messages: task.messages,

max_tokens: 1024,

});

}

// 高难度任务 → Opus 4.7 或 GPT-5.5(等 API 开放)

return opus47.chat(task.messages, { effort: 'high' });

}

七、DeepSeek V4 对 NixAPI 路由架构的影响

DeepSeek V4 的定价策略($0.14/M 输入)对 NixAPI 多模型路由的分层设计有直接影响:

| 层级 | 模型 | 输入成本 | 适用场景 |

|---|---|---|---|

| 免费 / 最低成本 | V4-Flash | $0.14/M | 简单任务、中文场景、成本敏感 |

| 中端 | V4-Pro / Sonnet 4.6 | $0.5-3/M | 中等推理、简单 Agent 工作流 |

| 高端 | Opus 4.7 / GPT-5.5 | $5/M+ | 复杂编程、科学研究、高可靠性需求 |

DeepSeek V4 的出现意味着 NixAPI 可以在不影响任务质量的前提下,为预算敏感型用户提供近 GPT-5 级别的能力。对于中文市场,这个价值尤为突出——DeepSeek 的中文理解和本地化能力远超西方闭源模型,且支持完全本地化部署(权重已开放)。

八、总结

DeepSeek V4 用 $0.14/M 输入的价格实现了接近顶级闭源模型的推理和编程能力,加上 1M context 原生支持和完全开源的权重,它是 2026 年开源大模型市场最具杀伤力的产品。对于 NixAPI,V4-Flash 是「成本优先层」的自然选择,V4-Pro 则可以承接中等难度的推理任务,整体形成「DeepSeek 兜底、顶级闭源模型攻坚」的分层路由架构。