MCP 协议狂飙:AI 工具互联的下一场标准化战争

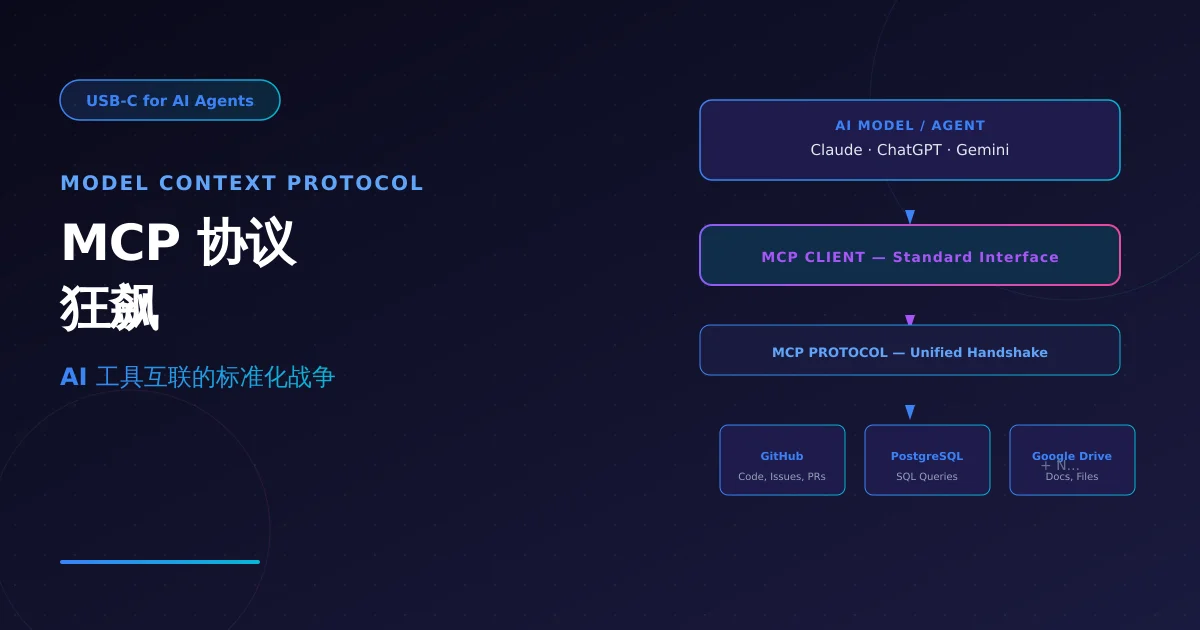

Anthropic 开源的 MCP(Model Context Protocol)正在成为 AI 时代的「USB-C 接口」——解决 AI Agent 无法统一调用外部工具的碎片化问题。StackAdapt、Anthropic、OpenAI、Google 正在加速布局 MCP 生态。本文解析 MCP 的核心技术原理、当前生态现状,以及对 API 聚合平台的意义。

声明: 本文事实来源为 Anthropic 官方发布页(modelcontextprotocol.io)、GitHub MCP Servers 仓库及 TechCrunch 报道。无任何未公开内部信息。

一、为什么需要 MCP

当前 AI 工具调用的「碎片化困境」

在 MCP 出现之前,AI 模型接入外部工具有多痛苦?

| 集成场景 | 传统方式 | 维护成本 |

|---|---|---|

| 让 AI 读取 GitHub 仓库 | 写一个 GitHub API 包装器 | 每个工具独立实现,无法复用 |

| 让 AI 查询 PostgreSQL | 写一个 SQL 工具 | 数据源变 → 代码全改 |

| 让 AI 读写 Google Drive | 写 OAuth + API 集成 | 重复造轮子,安全风险高 |

问题的本质:每个数据源需要单独的 custom implementation,无法 scale。

MCP 的核心设计思路

MCP = AI 界的 USB-C

就像 USB-C 用一个标准连接器替代了过去的 mini-USB、micro-USB、Lightning 混乱局面,MCP 用一个开放标准替代了「每个数据源单独集成」的混乱。

┌─────────────────────────────────────────────────────┐

│ AI Model / Agent │

│ (Claude, ChatGPT, etc.) │

└─────────────────────┬───────────────────────────────┘

│ MCP Client

│ (标准接口,无需关心具体实现)

┌─────────────────────┴───────────────────────────────┐

│ MCP Protocol │

│ (统一握手 + 工具描述语言) │

└─────────────────────┬───────────────────────────────┘

│

┌─────────────┼─────────────┐

↓ ↓ ↓

┌─────────┐ ┌─────────┐ ┌─────────┐

│ GitHub │ │ Postgres│ │ Google │

│ Server │ │ Server │ │ Drive │

└─────────┘ └─────────┘ └─────────┘

MCP Server MCP Server MCP Server

关键特性:

- 开放标准:任何人可实现,不依赖特定模型提供商

- 双向通信:工具调用结果可流回模型

- 安全隔离:MCP Server 可运行在本地,模型无法直接访问底层系统

二、MCP 协议架构解析

核心组件

MCP 协议包含三个核心组件:

| 组件 | 角色 | 说明 |

|---|---|---|

| MCP Host | AI 应用 | 想要接入工具的 AI 模型或 Agent(如 Claude Desktop) |

| MCP Client | 协议客户端 | 运行在 Host 内部,负责与 MCP Server 通信 |

| MCP Server | 工具适配器 | 暴露特定数据源/工具,实现标准 MCP 接口 |

工具描述格式

MCP 定义了标准化的工具描述语言,AI 模型通过它理解「这个工具能做什么」:

// MCP Server 暴露的工具清单示例

{

"tools": [

{

"name": "github_search_repos",

"description": "搜索 GitHub 仓库,支持关键词 + 语言过滤",

"inputSchema": {

"type": "object",

"properties": {

"query": { "type": "string", "description": "搜索关键词" },

"language": { "type": "string", "description": "编程语言,如 python" }

},

"required": ["query"]

}

},

{

"name": "postgres_query",

"description": "执行只读 SQL 查询",

"inputSchema": {

"type": "object",

"properties": {

"sql": { "type": "string" }

}

}

}

]

}

AI 模型看到这份清单后,可自主决定何时调用哪个工具——无需人工预定义工作流。

本地安全执行

MCP Server 可以运行在本地(localhost),AI 模型的所有工具调用都经过 MCP Client 代理:

AI Model → [MCP Client] → [MCP Server (localhost)] → 外部系统

↑

无直接网络访问

这意味着 AI 无法直接「翻墙」访问你的数据库——所有操作必须通过 MCP Server 定义的工具进行,天然安全隔离。

三、生态现状:谁在用 MCP

官方支持

- Anthropic:Claude Desktop 已内置 MCP Client,支持本地 MCP Server 接入

- OpenAI:ChatGPT 已支持 MCP,可接入外部工具

- Google:Gemini 通过 MCP 生态接入多种数据源

预建 MCP Server(官方仓库)

Anthropic 在 GitHub 开源仓库 modelcontextprotocol/servers 提供了预建服务器:

| MCP Server | 支持的功能 |

|---|---|

| GitHub | 搜索仓库、读取文件、创建 Issue/PR |

| Google Drive | 搜索文档、读取文件内容 |

| Slack | 发送消息、搜索频道历史 |

| PostgreSQL | 执行只读 SQL 查询 |

| Puppeteer | 控制浏览器自动化操作 |

| Filesystem | 本地文件读写(安全沙箱内) |

企业采用案例

| 公司 | 接入方式 | 场景 |

|---|---|---|

| Block(Square) | MCP 连接内部数据库 | 客服 Agent 实时查账 |

| Apollo | MCP 接入销售数据 | AI 销售助手分析客户数据 |

| StackAdapt | MCP Server 全面可用 | 广告平台 AI 助手调用内部数据 |

| Coder | MCP 接入开发环境 | 企业自托管 AI 编程 Agent |

四、MCP 对 AI 开发者的实际价值

从「手写集成」到「即插即用」

传统方式(每个数据源单独开发):

Claude → 写 GitHub 包装器 → 写 Postgres 包装器 → 写 Slack 包装器

↓ ↓ ↓

1周+ 3天+ 2天+

MCP 方式(标准协议复用):

Claude(内置 MCP Client)

↓

找 MCP Server → 插入 → 用

↓

5分钟配置搞定所有工具

开发者如何快速上手

// 1. 在 Claude Desktop 配置 MCP Server

// 路径:设置 → Developer → Edit Config

// claude_desktop_config.json

{

"mcpServers": {

"github": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-github"],

"env": {

"GITHUB_PERSONAL_ACCESS_TOKEN": "your-token"

}

},

"postgres": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-postgres"],

"env": {

"DATABASE_URL": "postgres://user:pass@localhost/db"

}

}

}

}

// 2. 开始使用——Claude 会自动发现可用工具

// 直接说:「查一下过去一周 GitHub 上 star 最多的 NixAPI 相关仓库」

五、NixAPI 的 MCP 接入价值

对于 NixAPI 这样的多模型 API 聚合平台,MCP 意味着:

// NixAPI × MCP:多模型 + 统一工具调用

import { NixAPI } from '@nixapi/client';

import { createMCPClient } from '@nixapi/mcp';

// 一个配置,接入所有工具

const client = createMCPClient({

apiKey: process.env.NIXAPI_KEY,

servers: [

{ name: 'github', endpoint: 'http://localhost:3000/github' },

{ name: 'postgres', endpoint: 'http://localhost:3000/postgres' },

{ name: 'filesystem', endpoint: 'http://localhost:3000/filesystem' },

],

});

// 用任意模型调用统一工具接口

const result = await client.chat({

model: 'claude-3-5-sonnet',

messages: [

{ role: 'user', content: '分析一下我们数据库里过去30天的用户增长趋势' }

],

// 模型自动判断使用 postgres MCP Server

mcpEnabled: true,

});

核心价值:

- NixAPI 用户无需关心底层工具集成细节

- 不同模型(Claude/GPT/Gemini)使用同一套工具调用接口

- 工具生态可持续扩展,MCP Server 数量无上限

六、关键结论

| 维度 | 评估 |

|---|---|

| 协议成熟度 | 已有官方规范 + 主流厂商(Anthropic/OpenAI/Google)支持 |

| 生态广度 | 预建服务器覆盖主流工具(GitHub/DB/Slack/文件),社区持续增长 |

| 开发者采用率 | MCP Registry 已上线,npm 包生态正在形成 |

| 对 NixAPI 的价值 | 统一工具层让 API 聚合平台从「模型路由」升级为「Agent 能力平台」 |

MCP 不是噱头——它是 AI 从「单模型对话」走向「多工具协作」的必经之路。建议 NixAPI 开发者关注 MCP SDK 发展,评估将其纳入下一版本路线图的可能性。